在很多时候,面部承担着情绪沟通的功能,而我们通过面部表情传达的信息可能要远远多于语言本身。人的脸如同变化无穷的地貌一样,有无数微小差异还有高度复杂性。不管一个人的脸部特征如何,也不管背景、光照及角度如何,人们都能够轻易解读表情,我们不禁反问,机器可以做到吗?

情绪识别与人脸识别,同属计算机视觉的研究范畴,属人工智能细支之一。情绪识别从上世纪90 年代开始研究,如今面部表情识别已经不仅仅局限于安全监视和情报收集,它将渐渐融入我们的生活。

应用场景

你正在玩一款非常复杂的大型游戏,而且此时的表情非常恐怖(或者沮丧、困惑、喜悦),随后游戏的支线任务就会自动跳转到符合你当前心态的剧情。

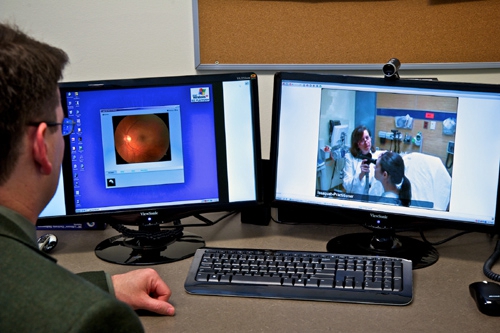

你通过摄像头做一个远程的医疗诊断,摄像头另一边的医生或者是医学软件不是通过口头描述来识别你的情况,而是通过你的表情状态。在检查的过程中,就算是面部的轻微肌肉收紧都会被察觉,这种类似的应用,主要可以解读那些无法自我表达的病人的心理情绪,例如抑郁症、自闭症、瘫痪的病人等。

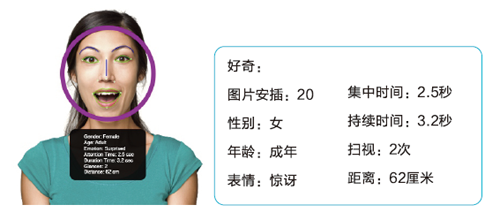

逛商场进店后肯定会东张西望,也许恰巧你会注视一个宣传视频,表情识别系统技术会抓取让你眼睛“发亮”的瞬间,这种信息的采集可以帮助商家调整宣传广告内容。同理广告公司使用面部识别,帮助评估观众对广告的反应,但有许多广告创意人员认为广告测试是对灵感的亵渎。

现在已经有零售商利用表情识别技术监控购物者在店内过道里的面部表情,来确定物品最佳的摆放位置,通过对顾客感受的实时分析,帮助零售业主提升销量。

目前表情情绪采集已经应用于商业,例如电视广告的监测,用户在看电视时,会通过摄像头来抓取用户当前心情,会播放相应的广告,当然也会记录下对广告的回应信息;家里有小孩看限制级片时,会被禁止;用户购买定制了什么节目,只需要刷脸就可以播放,不需要再用传统的账号密码登陆,轻松快捷。

老板用表情识别来监视员工的工作情绪,可以找情绪低下的员工谈心,或者嘉奖每天专心致志干活的员工,但是员工会觉得隐私被轻松窃取会影响工作心情。

智能温控器加上表情识别来判定用户心理状态:例如冬天开车回家,温控器的地域围栏功能已经用户感知的地理位置,便自动开启家里的空调和地暖。如果车子上的摄像头感应到用户心绪非常暴躁或者非常失落,温控器会进行二次判定,如果心态暴躁就微调低温度,心态沮丧就微调高温度,等家中的摄像头监测到用户心态趋于平静,就恢复正常温度。

西班牙一个戏剧俱乐部,为了增加收入,允诺观众免费对外开放,但是,每笑一次要收取0.3欧元,上限是80次。如果观众试图掩盖笑容,或是隐瞒笑的次数,就要收取全票价(24欧元),最终的结果是,剧院营业额暴涨。

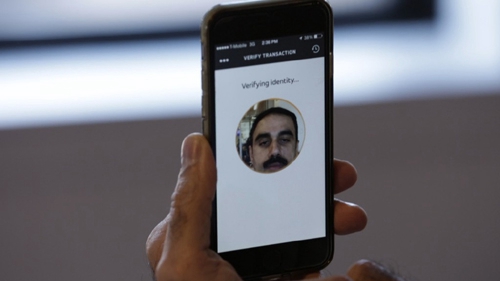

刷脸信用卡,阿里巴巴的微笑刷脸支付系统发布已经快一年了,国外也有类似的MasterCard提供眨眼支付,只需要对着手机眨眼几次,就可以进行支付验证,是一种新型替代指纹识别系统的工具。

在学校学习,老师授课过程中有表情识别分析系统的帮助,可以更好地把握学生们的学习进度,例如讲到学生们乏味的地方,系统自动提示可以跳过;讲到学生们困惑的地方,老师会更加深入重复讲解知识;也可以判定哪些同学分心来维护课堂秩序。

汽车的应用:首先坐到车内会脸部抓取合法驾驶人员信息,然后开车的时候如果困到流口水,这种表情会被情绪系统迅速抓取,就算是轻微的疲劳表情也会被警告。检测驾驶员困倦程度的系统对于安全驾驶非常重要,每年死于疲劳驾驶的人数都是高比例。还有就是路怒症患者的监测,系统会自动靠边停车,等到你表情趋于正常值以后,车子才能正常启动。当然不喜欢的人会拆了或者挡住摄像头,未来可能会被法律强制是违法行为。

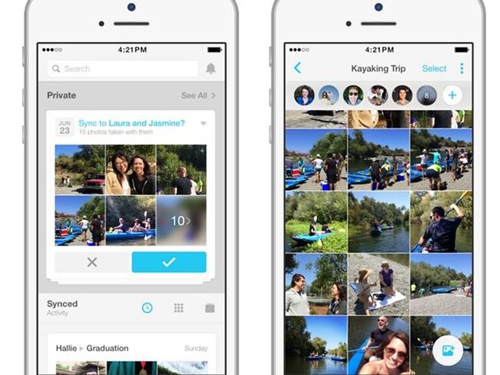

你正在使用电子相册,几千张照片中想选取你笑得最开心的,使用面部识别软件就可以自动提取并且创建新相册。你每天在朋友圈里发照片,日积月累就会有很多照片,通过表情识别系统来分类几种不同风格的相册,也可以将不同情绪下的你打上电子标签,以方便日后提取回忆。

电脑登陆刷脸可以很容易模仿,但是通过几个表情的辅助判定,可以让电脑更好的识别“假脸”,安全性更高,这也可以用到微信、微博的账户登陆。现在手机被盗窃或者丢失,别人可以很容易的登陆你的账户,但是通过毫秒级的刷情绪刷脸识别,就再也不用怕手机丢了。

隐私问题

上面的众多应用让我们眼花缭乱,心神向往。但是,表情判定技术涉及到了个人隐私问题。为 “呆滞” 的广告牌装上了 “智慧的眼睛”,由广告牌上的摄像头采集广告观众数据,包括不同日期、不同时间段内广告观众的人数、性别、年龄等等。有了这些数据,传统广告就可以开启智能化时代,但是你的喜好被互联网公开了。通过面部识别技术,希望能够最大化广告效果,同时减少资源浪费,让传统广告拥有互联网广告的那种洞察力。但还是那句担忧,我们的隐私被袒露无疑。有些不法分子可能会利用这些来试探受害人的心理底线,又或者说,我们少了一份购物的乐趣与自由。

表情识别的历史与进步

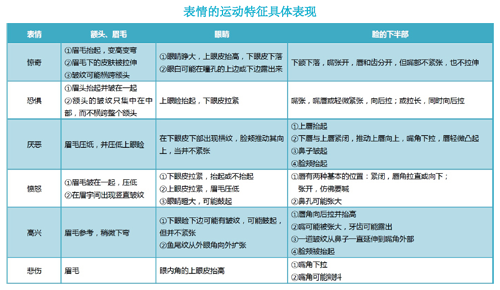

上世纪90年代,Paul Ekman解密了6 种基本表情 (即高兴、悲伤、惊讶、恐惧、愤怒和厌恶 ) ,并将其分解成46个独立动作,称其为“动作单元”的结合,但今天我们要面对更多的表情,如困惑、苦恼、分心、凝神、蔑视、反感等等。当时,Ekman汇编了面部动作编码系统(Facial Action Coding System或FACS),并且做了长达五百页的对于面部动作分类,它将面部动作编码系统(FACS)成功自动化,建立了一个能定位离散动作单元的系统,其中视频的每一帧都要花25秒数字化,对于有些关键帧,必须人工标注每一个面部移动。情感反应数据量增加,可以辨识出微笑的细微差别,也能辨识出更多的表情。情绪识别目前已经小众化应用,从计算机动画师到对撒谎微表情感兴趣的警员,这个系统已经在学界和专业领域运用了十几年。另一个消息,目前,剑桥正在创建所有人类表情的目录,目的是为了与自闭症患者交流,建立一个“情感助听器”。

情绪识别基本原理

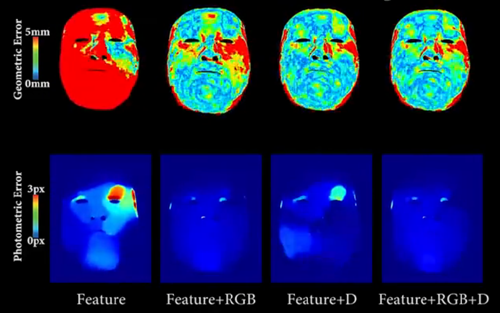

除了同人脸识别、人脸年龄估计一样,情绪识别受图象的拍摄环境、图像质量等因素影响,表情的识别算法更受脸部细节变化的影响,这就要求对人脸细节变化的感知做到更精准。将像素点分别归位到每个部位,鼻尖顶端的点是不会动的,类似这种不可变形的点作为锚点,帮助判断其他点移动的距离,再用几何模型渲染特征。微表情的判定可以分清“真笑”和“假笑”, 利用皮肤细纹的移动或者眉毛皱纹的分布扫描等方法,来判定微表情。

深度的情绪识别

情绪识别不仅仅只有面部的情绪、还有声音的情绪与肢体的情绪。

一些智能系统已经可以对音高、音色和响度进行分析,识别出深层次语义,比如根据一位女性和孩子的对话,可以辨别出这位女性是否一位妈妈,她是否在盯着孩子的眼睛看,以及她是失落还是高兴。可以分析人类遣词造句的方式,或者是解读肢体语言,然后判断用户的情绪。

“情感经济”

“关注度是网络空间里的强势货币。”虚拟经济会被新型的目标市场所驱动,而表情就是一个值得消费与开发的虚拟经济。我们免费使用的付费服务都是由关注度来买单的,最终形成其他行为的真实货币支出,这种关注不断在升值。移动互联碎片化的世界。将人们的关注度打的七零八落,又聚集在一个又一个小平台上,关注逐渐成为一种稀缺的资源,并且正因为这种稀缺性推动了对消费者认知的挖掘。这种“情感经济“会应用于未来互联网深层次的营销之中,无时无刻,无处不在。

前沿公司

Affectiva(波士顿)、Emotient(圣地亚哥)、Realeyes(伦敦)、和Sension(加州)中是目前表情识别成绩最突出的四家前沿公司,其中Emotient已经被苹果在一月收购,而Affectiva被众多风投看中,其中包括李嘉诚先生已投资的上千万美元。所以,今天我们分别对Emotient公司和Affectiva公司的CEO做了简单的采访。

面部识别技术目前已经成熟,伴随着它的快速增长,“情绪分析“也得到了飞速的发展。目前的情绪识别技术已经可以融合几十张图片来构成一张真实的图片,即使你做鬼脸、戴眼镜、改变发型或者留胡子,都没法逃脱摄像头的法眼。

利用图像处理、人工智能、计算机视觉等技术帮助,通过使用网络摄像头或智能手机监测追踪人的面部表情数据。人脸数据库,每一帧都有多达7个面部动作注解,比如皱眉意味着困惑,而眉毛向上抬起则表示惊讶。此外还会有其他面部特征帮助一起进行情绪识别,使分析结果更有说服力。Emotient利用摄像头来捕捉、记录面部肌肉运动,并根据其计算模型来分析出面部表情,最终得出关于表情的动态结果,普通的网络摄像头就能够支持分析。而且Emotient提供API接口,能够将其技术轻松地与任何硬件或者软件进行整合。Emotient也将同时作为英特尔RealSense技术SDK的一部分,用来迅速地与世界上的开发者进行对接。

在用户掩饰自己的表情之前,在四分之一秒内,机器就已经察觉到用户的微表情动态。这种很直接的情感输入的信息将是真实的,这种洞察力可以给提供更好的市场和营销决策指导,而不是靠着用户自己说或者书面的反馈,用户的喜好和消费习惯都可以了如指掌。

通过像素间距离的采集与庞大信息库(几百万面部特征数据)对比,就可以获得正确的情绪采集。我们有所有面容的全貌数据,如果你在微笑,但是你的眼睛没有跟着“微笑”,系统会判定你不是真正的微笑。而这个数据库每天还在增加十万帧人脸图像,以获得更高的准确率。皮克斯的《头脑特工队》动画电影就在说情绪的故事,而Emotient就是研究这个领域的公司。

有一部分人支持面部识别的价值,想让数不清且记不住的密码都消失,我们相信“识别”可以改变人们使用硬件的使用习惯,表情互动又是一个新的人机互动方式,未来相当一部分的机器只能识别带有表情的脸,因为带有表情的脸才是人脑思维的体现,交互的过程就是思维与思维交流的碰撞。

我们期望情绪识别可以跟更多的生物传感器对接,来搭建更多的连接点。目前英特尔公司做的最好,RealSense的软件开发套件包括了许多相关设备项目的开发,如面部、动作、语言的监测功能,一种3D立体监测方式正在被构建,它的“AIM Suite“技术利用摄像机和面部监测软件可以确定消费者的年龄、性别。

目前Emotient已经成功可以抓取多个目标的表情,在体育赛事的直播中,直接抓取表情最丰富的一个观众或者一批观众,随着这个需求的不断扩大,公司也在不断的进行发展采取多种经营模式,未来是大数据的时代,我们也将在隐匿的情况下搜集信息,以保护被检测者的隐私。目前美国准备在这两年颁发情绪识别许可证,公开与透明是对消费者最大的隐私保护。

深度表情识别的分辨率已经可以达到97%,远远超过人类的辨识率,而且未来还会朝99%的目标努力,这需要更好的算法。

我们期望情绪识别可以改变很多行业,Affectiva在整个未来社会的搭建中提供技术交流的工具,我们甚至通过情绪识别技术来促成更多的“有情人终成眷属”。目前我们的软件应用于移动终端、游戏、娱乐测试还有广泛的第三方服务。随着物联网的发展,每个设备都会内置“情绪感知”芯片来感觉我的情绪,然后在此基础上采取行动。营销和娱乐公司已经通过Affectiva的Affdex软件来获得娱乐节目和电影预告片的用户情绪反馈。例如通过评估观众一些无意识的面部反馈(如打哈欠、头部倾斜或眼神游离),来判定电视剧是否受到观众喜欢,如果观众不喜欢里面的两个角色在一起,未来的电视剧剧情里,这两个角色永远都不会在一起,更加智能的剧情将会获得更多观众的芳心。

Affectiva采集了75个国家总共300万张脸的信息,联合利华公司是我们的合作伙伴,在不同国家的超市中,我们放了一段广告和一段剪辑的视频,通过摄像机的采集来分别不同文化区域的反应,我们发现了很多微妙的差异。

Denman和Zijderveld都指出,未来不仅仅只停留在单纯地对人脸进行识别,情绪识别在商业、娱乐、医疗等领域的应用都是广泛的,对于安全监视方面,从面部特征就可以预估潜在的恐怖分子。

你的眼神不会说话,店里的销售人员从言语中无法准确把握客户是否喜欢这个商品,但是情绪识别加上肢体语言的传达可以让销售人员准确且快速地把握客户心理,促成交易。这种取代传统察言观色的方式,是受到商家追捧的。

面部识别技术正在推动着电子领域的发展,根据海外最新市场预测,到2020年,全球将有29亿美元的面部识别需求。届时将会有21%的智能城市和智能建筑会使用整套的人脸识别系统,今年的巴西奥运会上会有大量的人脸识别系统投资需求,对于已知恐怖分子的识别都是非常重要的。

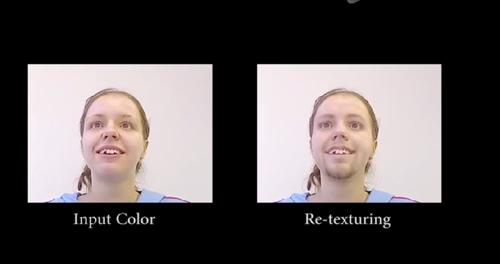

面部表情交换技术

除了表情判定采集,实时交换面部表情也已经成功应用。

上图中:左边男性没有做任何表情,两台电脑都里呈现出右边男性的表情。

这种技术应用于电影动画或者游戏制作非常棒,坐在设备前就可以模拟出任何真脸的表情,awesome!

苹果公司的未来iPhone

为何要讨论这个话题?首先我想让读者对情绪识别应用的理解更加“接地气”,其次是因为我们的目前智能手机并没有我们想象的智能。

苹果公司当然想把iPhone做的更智能,6S的3D Touch的应用还只是停留在手指的多方位互动,表情的互动是未来苹果手机的下一步计划,苹果智能手机对于表情识别的应用趋势已经在计划之中,未来终会有一款iPhone开启苹果的情绪识别时代:

▲苹果最新移动操作系统iOS 9中包括Siri应用推荐功能:向下滑动主屏,你会看到Siri认为你即将会使用的4款应用。但是如果使用表情识别功能,就可以结合情绪抓取来获取你的焦点注意力,利用前置摄像头评估你的心情来推荐更适合的下拉应用。

▲面部表情中蕴含着与抑郁或创伤后应激障碍有关的信息,我们可以利用它评估疼痛程度等信息,未来手机可以测试包括心率、步数、卡路里消耗、血糖、胆固醇等诸多信息,再加上表情采集可以轻松追踪用户的情绪健康。

▲例如你想在你的手机或者网络相册里搜索,带有笑脸的“快乐照片”,使用笑脸照片抓取软件即可。

▲苹果目前已经掌握了用户的很多信息,比如你住在哪里、下载哪些内容、在Apple Music上听过哪些音乐、在Apple News中订阅和阅读过哪些内容等,并据此向用户发送更有针对性的广告。未来iPhone能够了解你在特定时刻的感受,它就能更好地针对你发送广告。

▲在Apple Store上通过表情采集来评估消费者的购物体验,并加以改善。

▲视频推广,如果你在iPhone上观看视频,根据用户表情波动的记录来判定是否喜欢这个视频,如果表现出哈哈大笑或者专心致志的表情,会推送更多类似的视频。

面向未来的情绪识别:

目前众多前沿公司都在申请相关专利。

FaceBook:使用面部识别来多维度扩展社交关系网。

Apple:使用面部识别来锁定和解锁手机。

Amazon:通过视频分析来认证用户身份。

Google:单点或多点的实时面部交互技术

Toyota:人脸识别模块

Sony:人脸识别的检测

Fujifilm: 根据人脸变化时间的的精准识别

Comcast:应用于视频的手势识别与人脸识别的装置

编辑点评:

其实我们在沸沸扬扬地争吵着语言识别是否适合智能家居时,我们也只是处在“识别”的起跑线上,未来的智能家居产品不仅仅可以识别基础的语音内容,还包括其中语音情绪、方言、句子的分析,当然还会有面部识别、面部情绪识别、肢体语言识别,最终组成的就是人工智能的识别。当然达到完美还需要很长很长的路要走,至少我们现在听到的机器语音播报生硬度越来越低,方言识别率也越来越好,没有人机交互的进步,就没有智能家居的未来。去年11份的海外栏目,介绍了一款拥有表情判定的DIY网关Matrix,说明表情判定功能正在走进智能家居的千家万户,也是目前设计师们所追求的前沿技术。假设APP控制方式是智能家居1.0时代,语音控制是2.0时代,那么通过摄像头来“读心”,就是3.0时代,当然还有更加高级的终端控制方式,但是一句话,多智能终端一定需要情绪识别。